Autore: Stefano Costa

-

Africa. Le collezioni dimenticate

È finita a Torino la mostra “Africa. Le collezioni dimenticate” allestita nelle sale di Palazzo Chiablese. Sono riuscito a visitare la mostra pochi giorni fa. Mi è piaciuta molto. La mostra è stata organizzata dai Musei Reali di Torino, dalla Direzione Regionale Musei Piemonte e dal Museo di Antropologia ed Etnografia dell’Università di Torino, ed…

-

In…segnami il silenzio

Ieri sera siamo andati al Teatro Gustavo Modena, qui vicino a casa, per uno spettacolo della stagione dedicata all’infanzia. Eravamo con altre famiglie, ci siamo persino fatti un aperitivo casalingo prima di andare, visto che iniziava alle sette e mezza. Lo spettacolo si intitola “In…segnami il silenzio” e ha come protagonisti Marcello e Maria. Marcello…

-

ènostra e la transizione energetica dal basso a Savona

Venerdì 1 marzo ero a Savona per parlare di transizione energetica dal basso alla Società di Mutuo Soccorso Fornaci, insieme al gruppo territoriale di ènostra. Ci avevano invitati il comitato No rigassificatore e il comitato Fermiamo il mostro per una serata insieme a due associazioni genovesi con cui collaboriamo spesso, Cittadini sostenibili e CER Sole.…

-

Install iosacal with conda

Starting today, you can install iosacal with conda. This adds to the existing installation procedure with pip. Conda is a good fit for complex projects and has better tooling for reproducibility. Installing iosacal can be achieved by adding conda-forge to your channels with: conda config –add channels conda-forge conda config –set channel_priority strict Once the…

-

IOSACal in Google Colab

Google Colab is a popular notebook service that you can run directly from your browser. Python is natively supported and it’s fairly easy to run a Jupyter notebook, even with custom dependencies like Numpy and Matplotlib. You can run IOSACal in Google Colab! I have added a new short how-to guide in the official documentation.…

-

I libri che ho letto nel 2023

Fine anno, tempo di elenchi (bilanci, no). Nel 2023 ho letto pochino. David Graeber, Debito Questo è il libro che mi ha impegnato per più tempo. È un saggio, ed era da tempo che non leggevo un saggio, non sono più abituato allo stile e all’impegno richiesto. È un testo rivoluzionario a livello sociologico e…

-

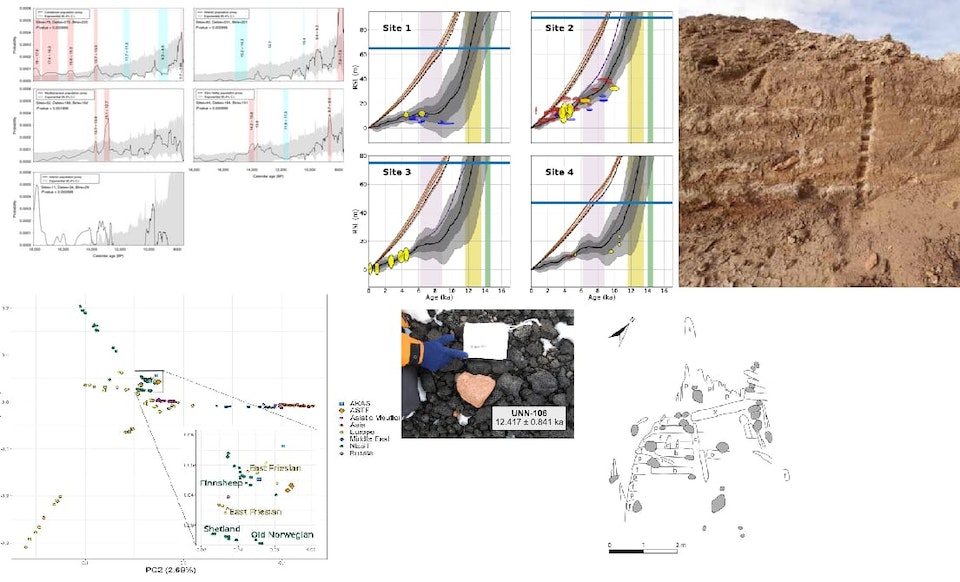

Research papers and case studies using iosacal

I have updated the documentation of iosacal with a new page that lists all research papers and case studies where the software gets a mention for being used. The list is at https://iosacal.readthedocs.io/en/latest/literature.html and it’s longer than I thought, with 6 papers ranging from Norway to Antarctica, from the Last Glacial Maximum to the European…

-

Gli atti del workshop Archeofoss 2022 sono stati pubblicati

Gli atti del workshop Archeofoss 2022 sono stati pubblicati in open access su Archeologia e Calcolatori. Li trovate qui http://www.archcalc.cnr.it/journal/idyear.php?IDyear=2023-07-26 come numero 34.1 della rivista. Ho curato insieme a Julian Bogdani l’edizione di questo volume ed è quindi motivo di soddisfazione, anche per i tempi rapidi con cui siamo arrivati alla pubblicazione grazie al lavoro…

-

I servizi da tè e caffè di Laveno al Museu Nacional Feroviario del Portogallo

Ho scritto un articolo sul nuovo forum per gli appassionati di ceramica italiana. Treni e tazzine da caffè, una accoppiata particolare!

-

Sono vegetariano da due anni

In questi giorni di fine luglio, due anni fa, ho deciso di smettere di mangiare carne e pesce e animali. Per un po’ di tempo, mi sono detto, ci provo. E sono passati due anni. Perché? Non è stata una decisione improvvisa e penso che siano anni che mi porto dietro l’idea di non nutrirmi…